OpenAIs neue KI-Modelle erkennen Standorte präziser – doch der Datenschutz bleibt fraglich

Hannah Böhm

OpenAIs neue KI-Modelle erkennen Standorte präziser – doch der Datenschutz bleibt fraglich

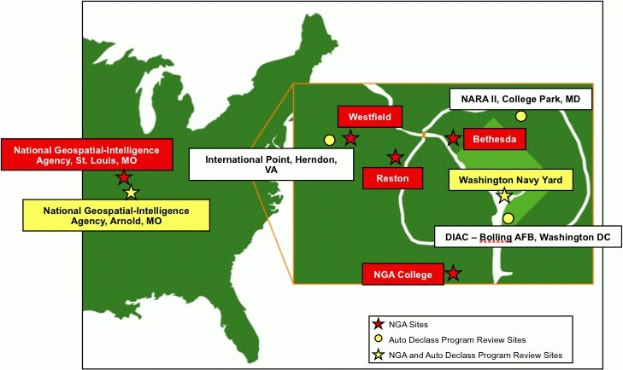

OpenAI hat zwei neue KI-Modelle vorgestellt: o3 und o4-mini, die darauf ausgelegt sind, Standorte anhand von Fotos zu identifizieren. Die Tools analysieren visuelle Details und gleichen sie mit Onlinedaten ab, um Städte, Wahrzeichen oder sogar konkrete Orte präzise zu bestimmen. Ihre Treffsicherheit hat Debatten über mögliche Anwendungen ausgelöst – aber auch über die Risiken für den Datenschutz.

Die neuen Modelle übertreffen ältere Versionen, insbesondere bei unscharfen oder stark bearbeiteten Bildern. Sie können Fotos zuschneiden, drehen und vergrößern, um selbst aus verschwommenen oder verzerrten Aufnahmen noch Informationen zu extrahieren. Überraschenderweise konnten bereits frühere KI-Systeme ohne fortschrittliche Bildverarbeitung erstaunlich genaue Vermutungen anstellen – ein Beweis für die Stärke der zugrundeliegenden Algorithmen.

Nutzer auf Social-Media-Plattformen wie X experimentieren bereits mit der Technologie. Manche behandeln sie wie eine KI-gestützte Version von GeoGuessr und testen, wie gut die Modelle zufällige Standorte auf Bildern erraten. Doch jenseits des spielerischen Einsatzes könnten die Tools auch in Bereichen wie Strafverfolgung oder Stadtplanung nützlich sein.

Trotz des Potenzials hat OpenAI bisher keine konkreten Sicherheitsvorkehrungen für o3 und o4-mini genannt. Es gibt derzeit keine klaren Schutzmechanismen, um Missbrauch zu verhindern – etwa die Identifizierung von Personen ohne deren Zustimmung. Diese Lücke verstärkt die Forderungen nach ethischen Richtlinien und strengeren Schutzmaßnahmen, um den Missbrauch solcher leistungsstarker KI-Systeme zu verhindern.

Die Einführung von o3 und o4-mini wirft die Frage auf, wie sich Innovation und Privatsphäre in Einklang bringen lassen. Zwar bieten die Modelle eine präzise Standorterkennung, doch das Fehlen integrierter Sicherheitsfunktionen eröffnet Missbrauchsmöglichkeiten. Behörden und Entwickler stehen nun vor der Herausforderung, Regeln für einen verantwortungsvollen Umgang mit dieser Technologie zu schaffen.